Panduan Lengkap Laporan Keuangan Perusahaan Manufaktur

Apa itu laporan keuangan perusahaan manufaktur? Laporan keuangan perusahaan manufaktur adalah dokumen yang mencatat informasi…

Sean Thobias

Februari 6, 2025Meskipun pertanyaan mengenai bagaimana organisasi seharusnya menggunakan artificial intelligence (AI) bukanlah hal baru, pentingnya pertanyaan tersebut semakin meningkat seiring dengan munculnya teknologi baru seperti ChatGPT, Midjourney, dan berbagai alat AI lainnya. Di berbagai sudut, muncul pertanyaan: Bagaimana sebaiknya kita memanfaatkan alat AI untuk meningkatkan kinerja? Apakah kita bisa mengandalkan AI untuk membuat keputusan penting? Apakah pekerjaan kita akan digantikan oleh AI?

Kehadiran kecerdasan buatan dari perusahaan-perusahaan seperti OpenAI, Microsoft, dan Nvidia, bersamaan dengan tekanan persaingan di pasar, mendorong organisasi untuk mempertimbangkan aspek operasional dan etika dalam memanfaatkan teknologi seperti pembelajaran mesin dan model bahasa canggih.

Meskipun fokus banyak pemimpin bisnis pada tantangan operasional dan dampak disrupsi, pentingnya isu-etika sama urgennya. Regulasi yang lambat berkembang sejalan dengan laju teknologi yang pesat dalam kecerdasan buatan menjadikan tanggung jawab memastikan penggunaan teknologi ini dengan aman dan etis semakin penting di lingkungan perusahaan.

Tsedal Neeley dari Harvard Business Review meneliti cara pemimpin mengembangkan pola pikir digital dan mengatasi bias dalam model bahasa canggih. Ia telah mengidentifikasi praktik terbaik dalam teknologi organisasi dan menyoroti isu-isu penting untuk menjaga etika penggunaan AI. Untuk membantu Anda lebih memahami cara yang lebih baik dalam memandang masalah ini, berikut adalah delapan jawaban untuk pertanyaan umum yang sering diajukan seputar topik ini.

Interaksi dengan artificial intelligence (AI) berbeda dengan pendekatan terhadap teknologi baru lainnya. Sejarah teknologi menunjukkan peningkatan efisiensi dalam tugas-tugas melalui perkembangan alat baru, seperti peralihan dari pena ke mesin tik dan kemudian ke komputer. Walaupun alat-alat ini meningkatkan efisiensi penulisan, proses umum seperti penyusunan, penyempurnaan, dan pengeditan tetap konsisten.

Namun, AI merupakan hal yang berbeda. AI memiliki dampak signifikan pada pekerjaan dan proses kita. Kemampuannya mengenali pola-pola yang tak terlihat oleh manusia dan mengolah informasi menjadi wawasan, analisis, prediksi, serta saran, termasuk pembuatan draf otomatis. AI sebaiknya dipandang sebagai serangkaian sistem kolaboratif, bukan sekadar alat bantu.

Untuk menjalin kolaborasi yang efektif dengan AI dalam lingkungan kerja Anda, ada tiga hal utama yang perlu difokuskan:

Pola pikir digital adalah kumpulan sikap dan perilaku yang membantu individu melihat peluang baru melalui pemanfaatan data, teknologi, algoritma, dan kecerdasan buatan.

Tidak perlu menjadi programmer atau data scientist; yang dibutuhkan adalah pendekatan inovatif dan proaktif terhadap kolaborasi lintas disiplin, penerapan komputasi untuk pertanyaan relevan, dan adaptasi terhadap perubahan sebagai satu-satunya konstan yang dapat diandalkan.

Setiap anggota organisasi perlu berusaha memahami setidaknya 30% dari beberapa topik kunci seperti arsitektur sistem, kecerdasan buatan, pembelajaran mesin, algoritma, kerjasama dengan agen kecerdasan buatan sebagai rekan tim, keamanan siber, dan eksperimen berdasarkan analisis data.

Pengenalan AI baru dalam perusahaan menuntut karyawan menguasai pemrosesan data dan konten baru, menganalisisnya, dan menerapkan hasilnya untuk perspektif yang inovatif. Organisasi juga perlu struktur terintegrasi untuk maksimalkan potensi data dan teknologi.

Perusahaan perlu mempertahankan keterbukaan dengan mendirikan pusat pengetahuan dan data terpusat. Ini memungkinkan kolaborasi yang berkelanjutan. Dalam menghadapi perkembangan AI, langkah-langkahnya tak hanya teknologi saat ini, tetapi juga kesiapan mental dan penyesuaian struktural untuk masa depan.

Sebagai contoh, beberapa individu telah mengadopsi penggunaan AI generatif seperti ChatGPT dalam aktivitas harian mereka, tanpa harus menunggu persiapan atau kesediaan perusahaan untuk mengadopsi teknologi ini.

Struktur suatu organisasi mencerminkan arsitektur sistem teknologi di dalamnya, dan sebaliknya. Jika sistem teknologi bersifat statis, maka organisasi Anda juga akan cenderung bersifat statis. Namun, jika sistem teknologi bersifat fleksibel, maka organisasi Anda pun akan lebih fleksibel dalam menghadapi perubahan. Strategi ini telah berhasil diterapkan dengan sukses di perusahaan Amazon.

Pada suatu waktu, Amazon menghadapi kesulitan pertumbuhan akibat keretakan infrastruktur perangkat lunak di bawah tekanan. Untuk mengatasi hal ini, pendiri Amazon, Jeff Bezos, mengirim memo kepada karyawan, mewajibkan aliran data melalui Application Programming Interfaces (API). Langkah ini diambil untuk mengatasi kekakuan dalam sistem teknologi Amazon.

Penggunaan API memungkinkan perangkat lunak berbeda berkomunikasi dan berbagi data melalui protokol yang ditetapkan. Aturan ini ketat, dengan ancaman pemecatan bagi pelanggarannya.

Langkah ini berhasil mengatasi kekakuan dalam sistem teknologi Amazon dan menghasilkan dampak positif, termasuk menghapus batasan data antar tim, meningkatkan kerja sama tim, dan membangun model operasional Amazon berdasarkan perangkat lunak dan data.

Meskipun Anda mungkin tidak perlu menerapkan pendekatan yang sama dengan memberikan ultimatum keras, tetapi penting bagi Anda untuk mempertimbangkan bagaimana pengenalan AI dapat, dan seharusnya, mengubah cara operasi organisasi Anda agar menjadi lebih baik dan responsif terhadap perubahan.

Baca juga: Apa itu Transformasi Digital

Para pemimpin perlu menyadari bahwa pemahaman sepenuhnya terkait cara sistem AI mengambil keputusan tidak selalu memungkinkan. Meskipun AI mampu memproses data dengan cepat dan menjalankan tugas lebih akurat serta efisien daripada manusia, terdapat potensi bahwa AI dapat menjadi “kotak hitam,” di mana kita tidak memiliki pandangan langsung mengenai bagaimana keluaran atau hasilnya diperoleh.

Meskipun begitu, kita masih memiliki peran penting dalam meningkatkan transparansi dan akuntabilitas dalam proses pengambilan keputusan AI. Ada dua pendekatan utama yang dapat kita lakukan:

Callen Anthony, Beth A. Bechky, dan Anne-Laure Fayard menyoroti bahwa ketidaktampakan dan pemahaman yang sulit membedakan AI dari teknologi sebelumnya. Kedua karakteristik ini sulit terlihat karena AI beroperasi di latar belakang, seperti dalam Siri atau Alexa, namun juga dalam teknologi lain seperti sistem rem anti lock yang mengandung komponen AI tak terlihat. Pengembang AI sendiri kesulitan memahami cara model mencapai hasil dan data yang digunakan — baik positif maupun negatif.

Semakin besar peran kumpulan data dalam AI, semakin terungkap fenomena ini. Contohnya, model bahasa besar (Large Language Model, LLM) seperti ChatGPT dari OpenAI atau Bing Microsoft. Model ini dilatih dengan data luas dari buku, halaman web, dan dokumen internet. LLM milik OpenAI saja, memiliki 175 miliar parameter dan memprediksi hasil seperti kata, karakter, atau gambar berdasarkan konteks sebelumnya.

Fitur koreksi otomatis ponsel adalah contoh bagaimana akurasi dan ketidakakurasi prediksi terlihat. Yang menarik, ini tidak hanya terkait dengan ukuran data, banyak algoritma AI belajar sendiri, memperbaiki prediksi dengan data dan masukan pengguna, serta menambah parameter baru sepanjang waktu.

Kemampuan luas AI muncul karena sifatnya yang tak terlihat namun kuat dalam menemukan pola-pola di latar belakang. Kita belum punya cara untuk memahami bagaimana AI berfungsi atau memastikan keluaran yang adil. Ketidakjelasan ini adalah hasil alami dari teknologi kuat ini. Pemimpin harus bijak mengatur penggunaan AI, mendokumentasikan penggunaannya, agar masyarakat tahu keputusan yang dihasilkan AI didasarkan pada keraguan yang tepat termasuk risiko dan kelemahan.

Ringkasan penelitian berjudul Artificial Intelligence and the Future of Work yang dihasilkan oleh tim ilmuwan dari MIT, mengemukakan bahwa ada beberapa langkah yang dapat ditempuh untuk meningkatkan transparansi model AI. Upaya meningkatkan transparansi AI melibatkan praktik seperti fokus pada aspek-aspek kunci dalam data yang memengaruhi output AI, pengembangan model yang lebih mudah dipahami, dan penggunaan algoritma untuk menganalisis berbagai cara kerja model.

Ilmuwan terkemuka di bidang ilmu komputer dan AI, termasuk Timnit Gebru dan rekan-rekannya Emily Bender, Angelina McMillan-Major, dan Margaret Mitchell (juga dikenal sebagai “Shmargaret Shmitchell”), berpendapat bahwa pendekatan analisis premortem bermanfaat. Ini mendorong pengembang untuk mempertimbangkan risiko-risiko dalam proyek dan mencari alternatif terhadap rencana yang ada, meningkatkan transparansi dalam pengembangan teknologi di masa depan.

Pada Maret 2023, tokoh-tokoh terkemuka dalam industri teknologi, termasuk Steve Wozniak dan Elon Musk, didukung oleh para profesional dari perusahaan-perusahaan besar seperti Google dan Microsoft, mengeluarkan pernyataan bersama. Pernyataan tersebut mendorong agar pengembangan kecerdasan buatan dilakukan dengan transparan dan dapat dijelaskan.

Langkah ini dianggap krusial dalam mengarahkan teknologi ke masa depan yang lebih bertanggung jawab dan dapat dimengerti oleh publik secara luas, tidak hanya dalam lingkup akademis tetapi juga dalam industri.

Baca juga: 5 Keuntungan Dari Transformasi Digital

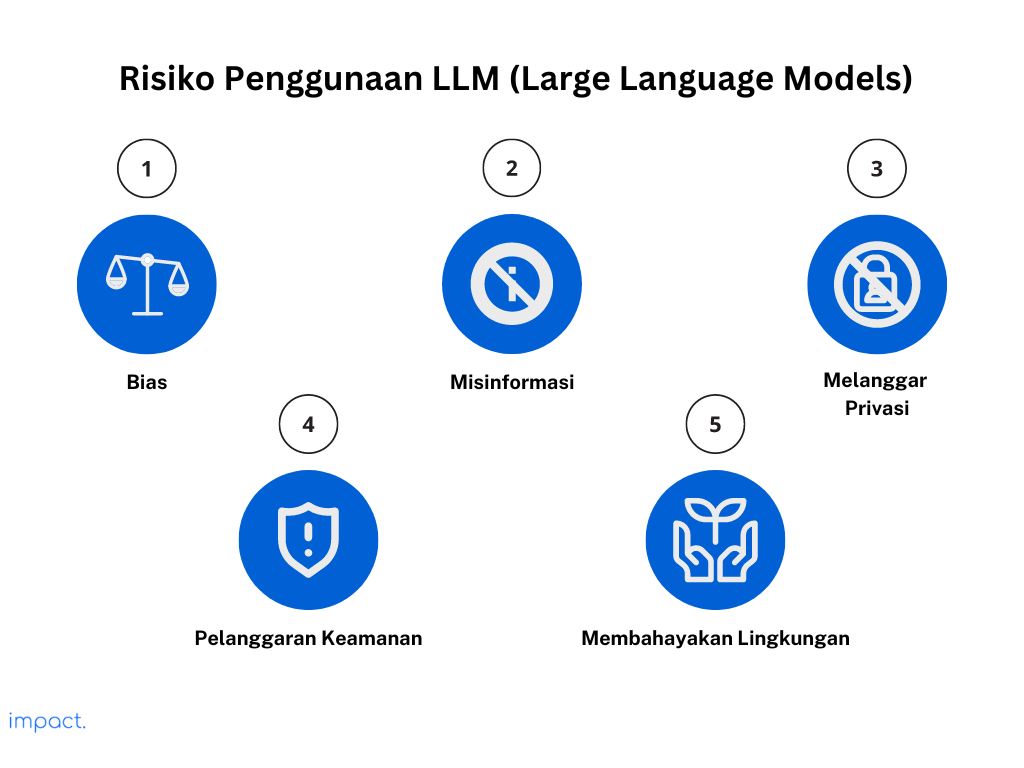

LLM memiliki beberapa risiko serius. Mereka dapat:

Kurasi data dan dokumentasi adalah dua cara untuk mengurangi risiko tersebut dan memastikan bahwa LLM akan memberikan tanggapan yang lebih konsisten dengan, dan tidak membahayakan, citra merek Anda.

LLM umumnya dikembangkan menggunakan data berbasis internet yang mengandung miliaran kata. Namun, sumber-sumber umum seperti Reddit dan Wikipedia, meskipun melimpah, kurang memiliki mekanisme yang memadai untuk memastikan akurasi, keadilan, dan relevansi informasi. Penting untuk mempertimbangkan sudut pandang yang terwakili dan yang tidak terwakili di dalam platform-platform ini.

Contohnya, sekitar 67% kontributor Reddit adalah pria, sementara di Wikipedia, proporsi kontributor pria mencapai 84%. Sementara itu, kontribusi dari kelompok-kelompok yang terpinggirkan relatif minim.

Memilih sumber daya yang diperiksa secara cermat saat membangun LLM dapat mengurangi risiko hasil yang tidak pantas atau berbahaya. Menurut Bender dan koleganya, kurasi data pelatihan sebaiknya didasarkan pada proses bijaksana dalam memilih data yang masuk, daripada hanya fokus pada skala dan menghilangkan data yang dianggap berisiko atau merugikan.

Meskipun pendekatan ini memerlukan investasi waktu dan sumber daya lebih banyak, prinsipnya sejalan dengan ide bahwa pencegahan lebih baik daripada pengobatan.

Organisasi sering menghadapi situasi di mana mereka ingin memanfaatkan Large Language Model (LLM), tetapi menghadapi keterbatasan sumber daya untuk melatih model dengan data yang terkurasi.

Dalam konteks ini, dokumentasi memegang peranan penting karena memungkinkan pemahaman tentang data yang digunakan, potensi bias, dan panduan implementasi perangkat lunak. Analoginya, hal ini serupa dengan praktik dalam dunia kedokteran di mana informasi sumber penelitian digunakan untuk merujuk rekomendasi layanan kesehatan.

Penting bagi pengembang AI untuk menekankan dokumentasi guna memastikan penggunaan model yang aman dan transparan. Bagi individu atau organisasi yang bereksperimen dengan model tersebut, pencarian dan pemanfaatan dokumentasi memiliki peran penting dalam memahami risiko yang terlibat dan kesesuaian dokumentasi dengan citra merek yang ingin mereka tonjolkan.

Sanitasi data merupakan tantangan yang dapat diatasi oleh organisasi Anda dengan mengutamakan transparansi dan keadilan daripada hanya mempertimbangkan ukuran model. Selain itu, juga penting untuk merepresentasikan beragam populasi dalam proses kurasi data.

Penting untuk mempertimbangkan trade-off yang dipilih dalam penggunaan sistem AI berukuran besar. Meskipun ukuran model tersebut efektif dalam tugas-tugas seperti simulasi interaksi manusia, perlu diingat bahwa ukuran yang terlalu besar dapat menyulitkan identifikasi dan penanganan potensi bias. Mengurangi risiko bias dapat dicapai dengan pengenalan dan dokumentasi risiko yang melekat pada data, termasuk opsi penggunaan kumpulan data yang lebih terkelola dan terkontrol.

Kedua, dengan melibatkan tim yang beragam, termasuk anggota populasi yang kurang terwakili, dalam pengumpulan dan pengolahan data pelatihan, Anda dapat meningkatkan peluang untuk memastikan inklusivitas perspektif dan identitas yang berbeda. Pendekatan ini juga bermanfaat dalam mengidentifikasi bias atau kesenjangan yang mungkin tidak terdeteksi dalam data.

Kepercayaan terhadap teknologi AI akan terwujud jika keadilan dijaga, dan hal tersebut hanya dapat dicapai melalui diversifikasi data dan tim pengembangan yang beragam. Dengan mendokumentasikan secara jelas bagaimana rancangan AI ditekankan demi keadilan, kita akan menciptakan dasar yang kuat untuk membangun sistem AI yang adil dan dapat dipercaya.

AI menggunakan data sensitif karyawan dan pelanggan rentan terhadap kejahatan. Organisasi perlu memahami pengembangan AI untuk menilai apakah data sensitif harus diintegrasikan dengan aman. Perlu adanya pembaruan teknologi dan alokasi sumber daya yang cukup untuk menjaga keamanan perangkat lunak. Upaya ini harus berkelanjutan karena celah kecil bisa membuat seluruh organisasi rentan terhadap pelanggaran.

Dalam hal ini, inovasi teknologi blockchain dapat memberikan kontribusi yang berharga. Teknologi blockchain berperan sebagai buku besar terdistribusi yang aman, mencatat setiap transaksi data dengan rinci. Keamanan ini dapat membantu melindungi integritas data. Contoh penerapannya sudah terlihat dalam berbagai aplikasi, mulai dari sistem pembayaran yang aman hingga mata uang kripto yang semakin berkembang pesat.

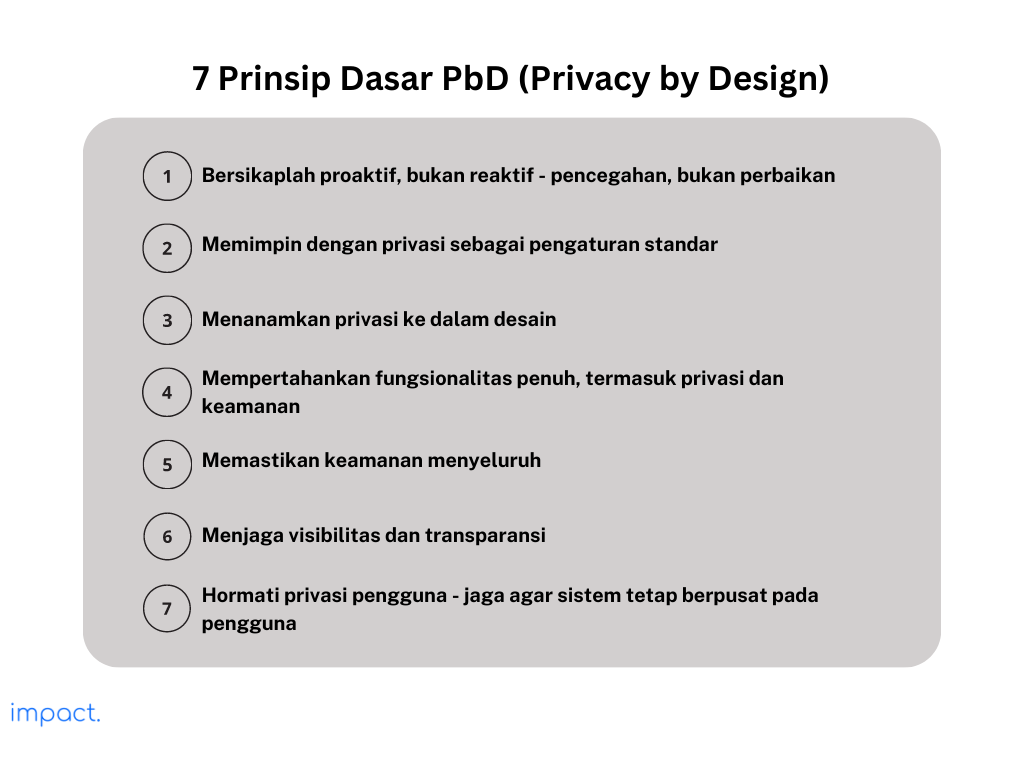

Dalam hal operasi Anda secara lebih luas, pertimbangkan kerangka kerja privasi berdasarkan desain (PbD) dari mantan Komisioner Informasi dan Privasi Ontario Ann Cavoukian, yang merekomendasikan agar organisasi menerapkan tujuh prinsip dasar. Ketujuh prinsip tersebut kami cantumkan pada gambar berikut:

Mengintegrasikan prinsip-prinsip PbD (Privacy by Design) ke dalam operasi perusahaan Anda melibatkan lebih banyak langkah daripada hanya merekrut staf khusus privasi atau membentuk divisi privasi.

Setiap individu dalam organisasi Anda harus memiliki kesadaran yang tinggi terhadap kekhawatiran pelanggan dan karyawan terkait masalah ini. Privasi bukan sekadar suatu refleksi, melainkan teknologi ini harus menjadi inti dari operasi digital, dan semua anggota organisasi perlu berupaya secara aktif dalam melindunginya.

Dengan hadirnya LLM (Large Language Model), teknologi AI tetap belum mampu menyelsaikan beragam tugas seperti halnya manusia. Terdapat berbagai aspek di mana kinerjanya justru masih di bawah rata-rata manusia. Untuk memanfaatkan alat baru ini secara efisien, pemahaman mendalam tentang tujuannya menjadi suatu keharusan.

ChatGPT memiliki kemampuan untuk mempelajari pola bahasa dan secara cerdas dapat memprediksi kata-kata untuk merespons pertanyaan kompleks. Namun, perlu diingat bahwa hasil yang dihasilkannya memiliki batasan.

Meskipun dapat menebak kata dan frasa yang masuk akal, kemampuan ini berbeda dengan pemahaman substansi materi. Misalnya, ChatGPT dapat menghasilkan puisi ala Shakespeare berkat pemahaman pola bahasa, tetapi tidak mampu menghasilkan pemahaman mendalam tentang makna kemanusiaan yang mendasari karya tersebut.

Di sisi lain, AI memiliki keunggulan dalam membuat prediksi dengan akurasi dan efisiensi yang melampaui manusia. Hal ini terjadi karena AI mampu memproses volume data yang jauh lebih besar dengan kecepatan yang lebih tinggi. Sebagai contoh, AI mampu melakukan prediksi awal terkait kasus demensia melalui analisis pola bicara, mendeteksi tumor kanker yang mungkin tidak terdeteksi oleh mata manusia, atau merencanakan rute yang lebih aman saat berada di medan perang.

Oleh karena itu, penting bagi para profesional untuk mengevaluasi apakah kekuatan AI cocok dengan tugas yang dihadapi dan layak digunakan. AI bisa menjadi pilihan yang tepat dalam situasi di mana diperlukan pemrosesan informasi besar dalam waktu singkat.

Selain itu, AI juga dapat berkontribusi dalam menghasilkan ide-ide baru yang berharga serta memberikan saran berarti dalam pengambilan keputusan sulit, asalkan model telah dilatih dengan data yang relevan.

Namun, perlu diingat bahwa penggunaan AI untuk menciptakan produk atau karya tanpa pengawasan manusia sebaiknya dihindari. Sebagai contoh, dalam pembuatan dokumen dengan konten serupa, AI dapat berperan sebagai alat bantu untuk menghasilkan “materi boilerplate.”

Akan tetapi, penting untuk menyadari bahwa hasil yang dihasilkan oleh AI didasarkan pada pola data dan algoritma, sehingga tidak selalu memiliki kualitas yang baik atau akurat secara otomatis.

Setiap gelombang revolusi teknologi telah menciptakan lebih banyak peluang pekerjaan daripada yang hilang. Sebelumnya, mobil meredupkan permintaan untuk pengemudi kereta kuda, namun seiringnya waktu, industri mobil membuka peluang baru seperti manufaktur dan perbaikan mobil, pengelolaan pompa bensin, dan banyak lagi.

Saat ini, teknologi AI juga menimbulkan kekhawatiran serupa akan menggantikan peran manusia dalam dunia kerja. Namun, pandangan ini sebaiknya diubah menjadi persepsi teknologi sebagai alat untuk memperkuat kinerja manusia. Sebagai contoh, perusahaan seperti Collective[i] telah berhasil mengembangkan sistem AI yang mampu menganalisis data dengan cepat, menghasilkan perkiraan penjualan yang sangat akurat.

Dulu, tugas semacam ini memakan waktu berhari-hari bahkan berminggu-minggu. Namun, dampaknya bukanlah pengurangan pekerjaan di bidang penjualan, melainkan pemberian waktu lebih banyak kepada para tenaga penjualan untuk fokus pada aspek-espek krusial dalam pekerjaan mereka, seperti membangun relasi, manajemen, dan kegiatan penjualan.

Hal yang sama berlaku untuk layanan seperti Codex dari OpenAI dapat menghasilkan kode pemrograman dasar secara otomatis. Ini tidak menggantikan programmer, tetapi memungkinkan mereka menulis kode dengan lebih efisien dan otomatisasi tugas-tugas berulang seperti pengujian kode. Dengan demikian, programmer dapat lebih fokus pada permasalahan kompleks seperti arsitektur sistem, pemodelan domain, dan pengalaman pengguna.

Dampak jangka panjang terhadap lapangan kerja tidaklah seragam dan dapat bersifat kompleks. Dalam beberapa kasus, terjadi peralihan dan penurunan lapangan kerja di sektor-sektor atau wilayah tertentu. Oleh karena itu, untuk memastikan bahwa kemajuan teknologi memberikan manfaat luas, investasi dalam pendidikan dan pengembangan tenaga kerja sangat penting. Ini membantu masyarakat dalam beradaptasi dengan perubahan di pasar kerja.

Individu dan organisasi perlu memusatkan perhatian pada peningkatan keterampilan dan perluasan pengetahuan guna mempersiapkan diri menghadapi perubahan teknologi. AI dan robot tidak akan segera menggantikan peran manusia. Dalam kenyataannya, yang lebih mungkin adalah bahwa mereka yang memiliki pemahaman mendalam tentang teknologi digital akan menggeser posisi mereka yang kurang memiliki pemahaman tersebut.

Penelitian “Gender Shades” pada 2018 oleh Joy Buolamwini dan Timnit Gebru menemukan bahwa teknologi pengenalan wajah dari perusahaan besar seperti IBM dan Microsoft sangat akurat dalam mengenali wajah pria berkulit putih, tetapi memiliki kesalahan sekitar 35% dalam mengidentifikasi wajah perempuan berkulit hitam.

Kesalahan semacam ini memiliki dampak serius karena teknologi pengenalan wajah digunakan dalam berbagai hal, termasuk membuka kunci ponsel, pemantauan acara, pengawasan protes, dan tindakan penyelidikan polisi. Kesalahan ini dapat mengakibatkan konsekuensi berat, termasuk penangkapan yang salah dan kerusakan pada reputasi dan kehidupan seseorang.

Dengan semakin meningkatnya peran dan integrasi AI dalam kehidupan sehari-hari, potensi risiko yang dihadapi juga semakin meningkat secara eksponensial. Oleh karena itu, sangat penting untuk mengadopsi strategi yang efektif guna melindungi perkembangan AI yang bertanggung jawab.

Agar terhindar dari bahaya perkembangan teknologi AI, kita harus beralih dari penekanan pada pengembangan canggih dan penerapan, dan fokus pada memastikan keamanan AI sebelum digunakan secara luas.

Transparansi sangat penting. Artikel ini menjelaskan bahwa deskripsi yang jelas tentang dataset dan potensi bias dalam pengembangan AI dapat mengurangi dampak buruk. Dengan membagikan algoritme secara terbuka, baik organisasi maupun individu dapat menganalisis dan memahami potensi risiko alat AI baru sebelum menggunakannya.

Pertanyaan mengenai siapa yang akan bertanggung jawab untuk memastikan keamanan dan tanggung jawab AI saat ini masih menjadi tanda tanya besar.

Pada 2020, Google membentuk tim AI berfokus etika. Namun, mereka kontroversially menghentikan hubungan dengan Gebru setelah ia mencoba menerbitkan makalah yang menyoroti risiko membangun model bahasa yang terlalu besar. Kepergian Gebru meragukan kemampuan pengembang teknologi sebagai pengawas internal. Baru-baru ini, tim Microsoft yang menangani etika juga diberhentikan.

Meskipun demikian, banyak pihak dalam industri ini sadar akan risiko-risiko tersebut. Seperti yang telah disebutkan sebelumnya, bahkan tokoh-tokoh teknologi ternama telah mendesak agar para pembuat kebijakan bekerjasama dengan para ahli teknologi guna menciptakan kerangka regulasi yang mengatur perkembangan AI.

Apakah itu berasal dari lembaga pemerintah, pelaku industri teknologi, atau badan independen lainnya, pendirian dan penguatan lembaga pengawas menjadi sangat krusial guna melindungi dari potensi bahaya yang disebabkan oleh perkembangan AI.

Lanskap AI yang selalu berubah mendorong pemerintah untuk mengatur perkembangannya. Di AS, tahun lalu, 21 undang-undang terkait AI diresmikan menjadi hukum.

Langkah penting termasuk ketentuan di Alabama yang mengatur penggunaan teknologi pengenalan wajah dalam hukum pidana dan pendirian Vermont Division of Artificial Intelligence. Divisi ini mengaudit penggunaan teknologi AI oleh pemerintah negara bagian, mengusulkan kode etik AI untuk tingkat negara bagian. Baru-baru ini, pemerintah federal AS juga mengambil tindakan eksekutif terkait AI, yang akan terus dievaluasi seiring waktu.

Di Uni Eropa, sedang dipertimbangkan Undang-Undang Kecerdasan Buatan yang mencakup sistem klasifikasi risiko AI terhadap kesehatan, keselamatan, dan hak dasar individu. Italia telah melarang secara sementara penggunaan ChatGPT.

Di Uni Afrika, terbentuk kelompok kerja AI dan African Commission on Human and People’s Rights mengadopsi resolusi untuk mengatasi dampak penggunaan teknologi AI, robotika, dan teknologi baru terhadap hak asasi manusia di Afrika.

Pada 2021, Tiongkok mengesahkan undang-undang perlindungan data yang mengatur izin penggunaan data. Baru-baru ini, negara ini juga mengeluarkan kebijakan unik terkait “teknologi sintesis mendalam” yang umumnya digunakan dalam “kepalsuan mendalam.” Di Inggris, pemerintah telah menerbitkan pendekatan baru untuk menerapkan panduan regulasi yang sudah ada pada teknologi AI inovatif.

Miliaran orang di seluruh dunia menemukan janji AI melalui eksperimen mereka dengan ChatGPT, Bing, Midjourney, dan alat baru lainnya. Setiap perusahaan harus menghadapi pertanyaan tentang bagaimana teknologi yang sedang berkembang ini akan diterapkan pada mereka dan industri mereka.

Bagi beberapa perusahaan, hal ini akan berarti perubahan yang signifikan dalam model operasi mereka; bagi perusahaan lain, kesempatan untuk meningkatkan dan memperluas penawaran mereka. Namun, semua perusahaan harus menilai kesiapan mereka untuk menerapkan AI secara bertanggung jawab tanpa menimbulkan kerugian bagi para pemangku kepentingan dan dunia pada umumnya.

Artikel terkait: AI Generatif: 3 Skenario Terkait Pembuatan Konten Masa Depan

Tim Insights Impact

Tim Insights Impact terdiri dari beragam individu profesional yang memiliki keahlian dan pengalaman dalam berbagai aspek bisnis. Bersama-sama, kami berkomitmen untuk memberikan wawasan mendalam dan pemahaman yang berharga tentang berbagai topik terkait strategi bisnis dan tren industri yang relevan.

Hubungi kami untuk mendapatkan perbandingan fitur lengkap dari 7 sistem ERP terbaik di Indonesia.